8 Fragen, 8 Antworten zum EU AI Act: Was CEOs und DSB 2026 wissen müssen

Der EU AI Act ist im Wesentlichen in Kraft getreten. Jetzt geht es um die systemische Umsetzung, ohne an Geschwindigkeit zu verlieren! Doch wer muss handeln, und wie sieht eine pragmatische Umsetzung aus? Wir haben die drängendsten Fragen hierzu direkt aus unserer täglichen Praxis kompakt für Sie zusammengefasst.

- „Wer sollte sich in einer Organisation um den AI Act kümmern?“

- „Anbieter vs. Betreiber: Wer haftet bei der Nutzung von Standard-Software wie Microsoft Copilot oder DeepL?“

- „Shadow-KI: „Wie inventarisieren wir Systeme, die offiziell gar nicht freigegeben sind?“

- „Die KI-Basis-Schulungen sind seit Februar 2025 Pflicht – wie holen wir die „AI Literacy“ jetzt am schnellsten nach?“

- „Was bedeutet der EU AI Act für deutsche Unternehmen?“

- „Welche Risikoklassen definiert der Au AI Act?“

- „Welcher Anbieter unterstützt bei EU AI Act Compliance“

- „Wenn wir das Thema gemeinsam mit eagle lsp angehen – kaufen wir dann nur eine weitere Software-Plattform, in die wir mühsam alles selbst eintippen müssen?“

„Wer sollte sich in einer Organisation um den AI Act kümmern?“

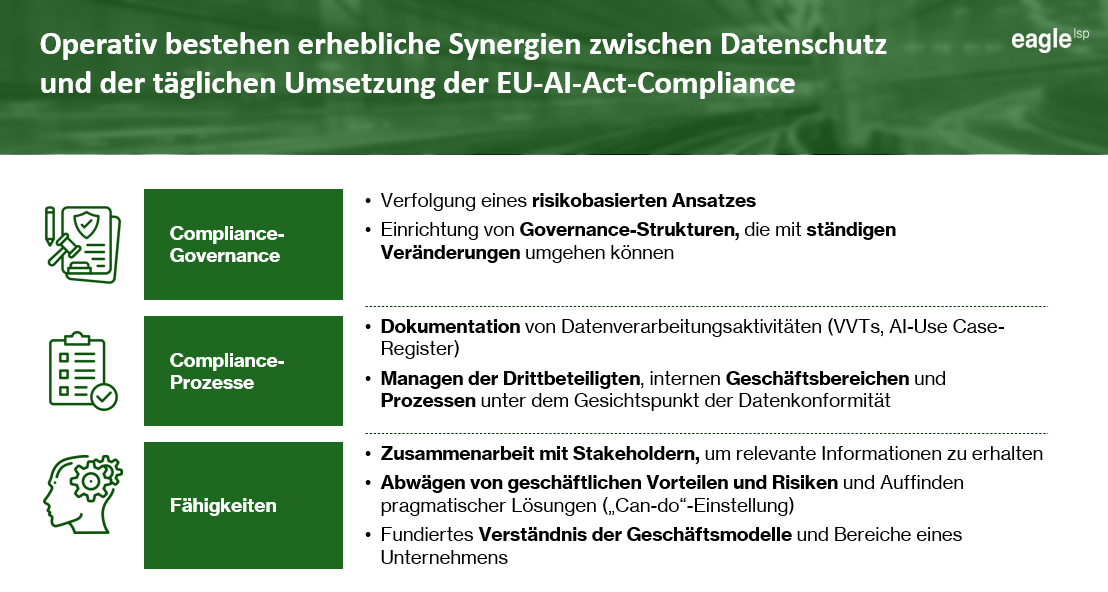

Oft wird die Verantwortung in der IT angesiedelt oder es wird eine neue Rolle dafür geschaffen. Unserer Meinung nach ist das Thema jedoch am besten beim Datenschutz aufgehoben.

Dafür sprechen drei wesentliche Gründe, die sich aus der täglichen Praxis ergeben:

- Gleichklang in der Governance (Nachhaltigkeit statt Einmalaufwand)

Sowohl Datenschutz als auch der EU AI Act sind keine Themen, die man mit einem „Stempel“ oder einem einmaligen Projekt löst. Es ist ein Irrglaube zu denken, man startet ein Projekt, setzt den AI Act um und ist fertig.

- Proaktive und reaktive Routinen: Man muss dauerhafte Prozesse einbetten. Wir müssen laufend beobachten, wie sich Systeme weiterentwickeln und wie die Mitarbeiter sie tatsächlich verwenden.

- Risikobasierter Ansatz: In beiden Rechtsgebieten geht es nicht darum, sofort 100 % konform zu sein, sondern ständig an den relevantesten Themen zu arbeiten und diese immer wieder neu zu priorisieren.

- Die bestehende Vernetzung (Schnittmengen im Unternehmen)

Der Datenschutz ist bereits die funktionale Schnittstelle im Unternehmen. Ein DSB arbeitet typischerweise extrem eng verzahnt mit:

- Der IT und dem CISO: Um technische Sicherheit zu gewährleisten.

- Der Rechtsabteilung: Für die juristische Rahmensetzung.

- Den Fachabteilungen (Marketing, HR, etc.): Dort, wo Technologie im täglichen Doing mit Menschen zusammenkommt. Da der DSB diese Vernetzung bereits besitzt und das Unternehmen aus dieser Perspektive sehr gut versteht, ist der AI Act nur ein kleiner Schritt entfernt. Es macht keinen Sinn, diesen „Kreis der Stakeholder“ für ein neues KI-Team mühsam neu aufzubauen.

- Identische operative Prozesse (Asset-Verständnis)

Die schematische Umsetzung ist bei beiden Gesetzen fast deckungsgleich. Egal ob Datenschutz oder AI Act – wir müssen uns in beide Felder hineindenken, um die gleichen Fragen zu beantworten:

- Asset-Erfassung: Welche technischen Lösungen werden verwendet und welche Prozesse sind für das Unternehmen wirklich relevant, um effektiv zu skalieren?

- Dokumentation & Risiko: Was wird im Unternehmen verwendet? Wo genau liegen die Risiken? Die Art und Weise, wie man hier vorgeht und was dokumentiert werden muss, ist bei beiden Gesetzen relativ ähnlich.

- Fähigkeiten & Pragmatismus: Ein guter DSB besitzt bereits die Fähigkeit, pragmatisch abzuwägen. Er muss ein „Enabler“ für das Business sein und helfen, Lösungen zu finden, statt sie zu verhindern.

Lasse Milinski: „Ich würde dafür keine neuen Rollen kreieren. Das Thema ist beim DSB-Team sehr gut aufgehoben, weil man die Synergien durch die bestehende Vernetzung und das Verständnis der Assets sofort nutzen kann. Ein neues Team würde uns nur extrem langsam machen.“

„Anbieter vs. Betreiber: Wer haftet bei der Nutzung von Standard-Software wie Microsoft Copilot oder DeepL?“

Hinter dieser Frage steht oft die Unklarheit, ob nur der Anbieter oder auch der Betreiber in der Pflicht ist. Die Verantwortung liegt maßgeblich beim Betreiber – also bei Ihnen als Unternehmen.

Um das rechtssicher einzuordnen, müssen wir die Nutzung im Detail betrachten:

- Die Frage der Datenverarbeitung Bei der Nutzung von Tools wie ChatGPT oder DeepL steht zuerst die Frage im Raum: Welche Daten gebe ich hier eigentlich hinein? Kann ich mir wirklich sicher sein, dass diese Daten nicht vom Anbieter weiterverarbeitet werden? Das sind zentrale Fragen, die allein der Betreiber für sich beantworten muss.

Nehmen wir ein praktisches Beispiel: Wenn Sie vertrauliche E-Mails übersetzen möchten und dafür eine freie Version nutzen, deren Server nicht in der EU liegen, geben Sie unter Umständen personenbezogene Daten preis. Aus Datenschutzperspektive ist das extrem schwierig – und die Verantwortung dafür liegt allein beim Unternehmen, das den Einsatz zulässt.

- Der Use Case bestimmt die Haftung Wir nutzen hier gerne das „Messer-Beispiel“: Ein Messerhersteller liefert ein Produkt, das dafür gedacht ist, Gemüse zu schneiden. Wenn der Nutzer damit jedoch in der Tischkante rumschnitzt, liegt das nicht in der Intention des Herstellers. Er wird für diesen Schaden nicht haften. Genauso verhält es sich bei der KI: Der Anbieter liefert die technologische Basis, aber Sie entscheiden über die Parametrisierung und den konkreten Einsatz im Betrieb. Wie beim Dieselgate-Skandal entstehen die eigentlichen Risiken erst dort, wo die Technik spezifisch angewendet wird.

- Die Definitionshoheit liegt beim Unternehmen Wichtig zu verstehen ist: Sie definieren als Unternehmen, für welche konkreten Probleme und in welchen Prozessen Sie KI nutzen möchten. Damit schaffen Sie den Anwendungsfall – und genau deshalb sind Sie als Unternehmen dann auch in der Haftung.

Den Risiken und Pflichten kann man nicht entkommen, indem man auf die Anbieter verweist. Man muss sich den eigenen Use Case genau überlegen. Wir unterstützen Sie dabei, diese Leitplanken so zu setzen, dass Sie die Chancen der Tools nutzen können, ohne die rechtliche Kontrolle zu verlieren.

„Shadow-KI: „Wie inventarisieren wir Systeme, die offiziell gar nicht freigegeben sind?“

In vielen Unternehmen nutzen Kollegen bereits private ChatGPT-Accounts für berufliche Zwecke – oft ohne Wissen der IT. Für die Verantwortlichen stellt sich die Frage: Wie lassen sich Systeme inventarisieren und Risiken bewerten, die offiziell gar nicht existieren?

In der Praxis lässt sich eine lückenlose Überwachung und Kontrolle kaum realisieren. Das ist auch dem Gesetzgeber klar. Wir empfehlen daher eine zweigleisige Herangehensweise:

- Verantwortung in die Fachabteilungen verlagern Ein strukturierter Prozess zur Identifizierung von Schattensystemen ist notwendig. Die Verantwortung hierfür sollte jedoch weniger beim Datenschutz oder der IT liegen, sondern in den Abteilungen, die die jeweiligen Prozesse und Ergebnisse (Outcomes) verantworten. Es ist entscheidend, die Transparenz-Verantwortung direkt ins Business zu geben: Ein Abteilungsleiter muss nachvollziehen können, wie seine Mitarbeiter im Alltag tatsächlich arbeiten.

- Globale Richtlinien als Leitplanken Es muss über eine globale Richtlinie eindeutig festgelegt werden, wofür KI genutzt werden darf und wo die Grenzen liegen. Ein konkretes Beispiel: Die Richtlinie kann vorschreiben, dass ausschließlich der interne, freigegebene Chatbot auf eigenen Servern genutzt werden darf, um einen unkontrollierten Datenabfluss zu verhindern. Gleichzeitig wird damit die Nutzung von freien Versionen für vertrauliche Daten explizit ausgeschlossen.

Die Lösung liegt in der Kombination aus der Eigenverantwortung der Führungskräfte in den Fachbereichen und klaren, unternehmensweiten Regeln. Nur so lässt sich das Risiko der Shadow-KI nachhaltig minimieren.

„Welche Risikoklassen definiert der EU AI Act?“

-

Inakzeptables Risiko (Verbotene Systeme): Bestimmte Anwendungen sind seit Februar 2025 strikt untersagt. Besonders relevant für Unternehmen: Emotionserkennung am Arbeitsplatz (z. B. zur Überwachung der Produktivität oder Stimmung) ist nahezu ausnahmslos verboten. Auch manipulatives Social Scoring ist untersagt.

-

Hohes Risiko (Hochrisiko-KI): Hier gelten die strengsten Auflagen. Dies betrifft vor allem das Personalwesen (Recruiting), die Kreditwürdigkeitsprüfung oder kritische Infrastrukturen. Wer hier agiert, benötigt ein iteratives Risikomanagementsystem (RMS) über den gesamten Lebenszyklus – von der Identifikation von Bias in Trainingsdaten bis hin zu regelmäßigen Stresstests.

-

Technische Dokumentation & Human Oversight: Für Hochrisiko-Systeme ist eine lückenlose Dokumentation der Systemarchitektur zwingend. Zudem muss eine menschliche Aufsicht (Human Oversight) technisch sichergestellt sein, damit eine natürliche Person die KI-Ausgaben hinterfragen und das System im Ernstfall manuell stoppen kann.

-

Begrenztes Risiko (Transparenzpflichten): Bei Chatbots muss offengelegt werden, dass eine KI interagiert. KI-generierte Texte müssen für Verbraucher nur dann gekennzeichnet werden, wenn sie Angelegenheiten von öffentlichem Interesse (Politik, Wirtschaft) behandeln. Eine normale E-Mail oder Website-Beschreibung fällt in der Regel nicht darunter.

„Die KI-Basis-Schulungen sind seit Februar 2025 Pflicht – wie holen wir die „AI Literacy“ jetzt am schnellsten nach?“

In vielen Unternehmen wurde die Frist vom Februar 2025 für die ersten KI-Basis-Schulungen schlichtweg verschlafen. Die Frage ist nun: Wie lässt sich das im Jahr 2026 schnell und rechtssicher glattziehen, ohne direkt ein riesiges Transformationsprojekt daraus zu machen?

Ein Blick ins Gesetz zeigt: Eine strikte Pflicht zu einem aufwendigen Training steht dort so nicht explizit drin. Auf Wunsch der Bundesregierung wurde die Anforderung etwas abgeschwächt und unter dem Begriff der „AI Literacy“ (KI-Kompetenz) zusammengefasst. Dennoch bleibt die unternehmerische Pflicht bestehen: Unternehmen müssen sicherstellen, dass ihre Mitarbeiter wissen, was sie bei der Nutzung von KI bedenken müssen.

Um dieses Versäumnis effektiv und effizient zu lösen, empfehlen wir folgendes Vorgehen:

- Pragmatisch starten statt individuell entwickeln Es ist nicht notwendig, für jeden Fachbereich sofort individuelle Schulungskonzepte zu entwerfen. Der effektivste Ansatz ist ein standardisierter Start für die gesamte Belegschaft. Es geht zunächst um ein grundlegendes Verständnis, das sich hervorragend über Online-Schulungen abbilden lässt.

- Fokus auf die Basis-Schulung Inhaltlich sollten diese Basisschulungen folgende Punkte abdecken:

- Worum geht es im EU AI Act überhaupt?

- Was ist eigentlich ein KI-System? (Abgrenzung zu herkömmlicher Software)

- Was darf ich im Unternehmen überhaupt machen? (Leitplanken für die tägliche Praxis)

- Praktische Übungen: Kurze, leichte Einheiten, um das Wissen zu festigen.

- Kein Transformationsprojekt erzwingen Wir raten ausdrücklich von einem großen „KI-Transformations-Projekt“ ab, nur um die regulatorischen Anforderungen zu erfüllen. Dieses Vorgehen ist bereits aus dem Datenschutz bekannt: Es geht um den Nachweis einer grundlegenden Awareness.

Wer die Fristen bisher versäumt hat, sollte jetzt auf skalierbare Online-Lösungen setzen, um das notwendige Grundverständnis im Unternehmen zu schaffen. Das Ziel ist es, die Mitarbeiter handlungsfähig zu machen, ohne die Organisation durch unnötige Komplexität zu lähmen.

„Was bedeutet der EU AI Act für deutsche Unternehmen?“

Die Europäische Union hat die bislang ganzheitlichste Regulierung zur KI-Anwendung geschaffen, die eine ethische und vertrauenswürde KI-Nutzung in den Vordergrund stellt. Damit priorisiert die EU die Persönlichkeitsrechte des Einzelnen vor ökonomischen Interessen. Während der EU AI Act die biometrische Echtzeit-Fernidentifizierung in öffentlich zugänglichen Räumen nahezu vollständig untersagt, unterliegt der Einsatz auf privaten Arealen – wie abgeschlossenen Werksgeländen – einer strengen Einzelfallprüfung

Wesentliche Inhalte des EU AI Acts:

Anwendungsbereich: Betroffen sind nicht nur Anbieter sondern auch Betreiber (Nutzer) von KI-Systemen – damit alle Unternehmen

Stets aktuelle Dokumentation der KI-Nutzung zur Compliance sicherzustellen (Strafe bis zu 3% vom Umsatz)

Basis-Schulung für Mitarbeiter zum Verantwortungsbewussten Umgang mit KI-Systemen ist Pflicht seit Februar 2025

Dokumentations- und Risikobetrachtungspflichten gehen über den bereits etablierten Datenschutz hinaus

„Welcher Anbieter unterstützt bei EU AI Act Compliance?“

Während viele Anbieter den EU AI Act als zweijähriges Transformationsprojekt behandeln, agiert eagle lsp als skalierbare Werkbank, die das Compliance-Problem operativ löst. Statt Einzelfallprüfungen und langwierigen Diskussionen setzt eagle lsp auf ein integriertes System, das direkt mit Ergebnissen startet und den EU AI ACT aus einer unternehmerischen Perspektive denkt.

„Wenn wir das Thema gemeinsam mit eagle lsp angehen – kaufen wir dann nur eine weitere Software-Plattform, in die wir mühsam alles selbst eintippen müssen?“

Hinter dieser Frage steht oft die Sorge vor einem hohen internen Zeitaufwand. Unser Ansatz ist ein anderer: Wir verstehen uns als Ihre „Werkbank“ und nehmen Ihnen die juristische Detailarbeit ab.

Die Zusammenarbeit gestaltet sich in der Praxis wie folgt:

- Die passende Software als Basis Ja, wir nutzen eine spezialisierte Software-Plattform, über die wir mit unseren Mandanten zusammenarbeiten. Wir schauen uns Ihr Unternehmen genau an und wählen dann die Variante aus, die am besten zu Ihren Anforderungen passt. Aber: Diese Plattform ist für Sie keine leere Hülle, die Sie mühsam befüllen müssen.

- Juristische Risikobewertung inklusive Der entscheidende Mehrwert liegt in unserer Expertise. Wir kennen die gängigen KI-Tools bereits sehr genau und haben fast jedes gängige System in unserem Team schon mehrfach rechtlich bewertet. Sie müssen das Rad also nicht neu erfinden. Wir bringen diese Erfahrungswerte direkt in die Plattform ein und übernehmen die eigentliche juristische Risikobewertung Ihrer spezifischen Use Cases.

- Minimaler Aufwand für Ihr Team Unser Ziel ist es, Ihren internen Aufwand so gering wie möglich zu halten. Während andere Lösungen oft nur die Struktur bieten, liefern wir den Inhalt und die rechtliche Einordnung gleich mit.

Eine Software allein löst kein Compliance-Problem. Erst die Verzahnung aus einer intelligenten Plattform und unserer fundierten juristischen Vorarbeit macht das Thema für Sie handhabbar. Wir liefern die Ergebnisse, damit Sie sich auf Ihr Kerngeschäft konzentrieren können.