Der EU AI Act in Deutschland: So schaffen Unternehmen jetzt eine vertrauenswürdigen KI-Landschaft

Die Europäische Union hat die bislang ganzheitlichste Regulierung zur KI-Anwendung geschaffen, die eine ethische und vertrauenswürde KI-Nutzung in den Vordergrund stellt. Damit priorisiert die EU die Persönlichkeitsrechte des Einzelnen vor ökonomischen Interessen.

Während der EU AI Act die biometrische Echtzeit-Fernidentifizierung in öffentlich zugänglichen Räumen nahezu vollständig untersagt, unterliegt der Einsatz auf privaten Arealen – wie abgeschlossenen Werksgeländen – einer strengen Einzelfallprüfung. Dort werden solche Systeme in der Regel als Hochrisiko-KI klassifiziert, was massive Dokumentations- und Transparenzpflichten auslöst. In Kombination mit den strengen Anforderungen der DSGVO (Art. 9) zur Verarbeitung biometrischer Daten schafft die EU damit auch für den betrieblichen Kontext weltweit die höchsten Hürden gegen unkontrollierte Überwachung.

EU AI Act Zusammenfassung: Die wichtigsten Regeln und Fristen für 2026

Ab August 2026 treten die meisten materiellen Pflichten des EU AI Acts in Kraft. Jetzt geht es um die systemische Umsetzung, ohne an Geschwindigkeit zu verlieren!

Die Europäische Union verfolgt mit der KI-Verordnung einen klaren Kurs: Die Schaffung einer ethischen und vertrauenswürdigen KI-Landschaft. Im direkten Vergleich zu den liberalen Ansätzen in den USA oder der staatlich dominierten Überwachung in China, priorisiert die EU die Sicherheit und Grundrechte des Einzelnen vor rein ökonomischen Interessen.

Individualrechte vs. ökonomische Interessen

Der Kern des AI Acts liegt darin, dass jeder Bürger sichergehen kann, keine persönlichen Nachteile durch KI-Systeme zu erfahren. Dies wird besonders bei der biometrischen Echtzeit-Fernidentifizierung deutlich. Während diese in öffentlichen Räumen nahezu vollständig untersagt ist, unterliegt der Einsatz auf privaten Arealen – wie abgeschlossenen Werksgeländen – einer strengen Einzelfallprüfung. In Kombination mit der DSGVO (Art. 9) schafft die EU damit weltweit die höchsten Hürden gegen unkontrollierte Überwachung und setzt den Standard für Artificial Intelligence Governance.

Das neue EU-Gesetz zur künstlichen Intelligenz und die Verordnung über Künstliche Intelligenz im Detail

Als weltweit erstes umfassendes EU-Gesetz zur künstlichen Intelligenz etabliert der EU AI Act einen verbindlichen Rechtsrahmen, der sicherstellen soll, dass KI-Systeme sicher, transparent und vertrauenswürdig gestaltet werden. Gemessen an seiner Komplexität ist das Gesetz in Rekordzeit erarbeitet worden und seit dem offiziellen Inkrafttreten am 1. August 2024 hat sich der Fokus von der rein theoretischen Regulierung von KI hin zur praktischen Durchsetzung verschoben. Analog zur europäischen Datenschutzverordnung (GDPR), wird sich die konkrete Auslegung über die nächsten Jahre insbesondere durch konkrete Rechtsprechung in der Praxis ausgestalten. Für Compliance-Abteilungen in Deutschland ist das Jahr 2026 der entscheidende Wendepunkt, da die Übergangsfristen für Anwendungen mit hohem Risiko auslaufen und die Einhaltung der Vorschriften durch die nationalen Behörden kontrolliert werden wird.

Zeitplan, Inkrafttreten und Einhaltung in Deutschland

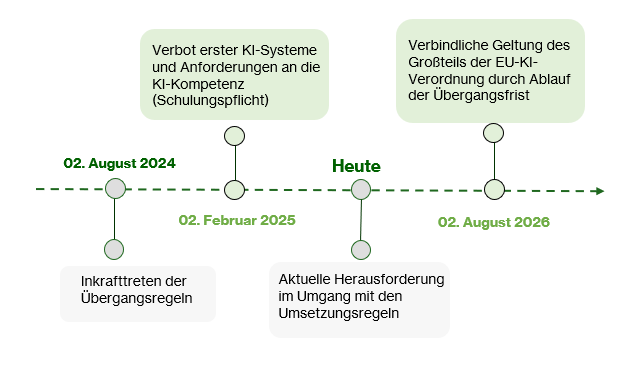

Der Fahrplan des AI Acts ist streng getaktet. Während der erste Entwurf noch Raum für Spekulationen ließ, sind die Fristen heute Realität. Am 23.01.2025 hat die EU-Kommission jedoch ein Omnibus-Verfahren auf den Weg gebracht, um den Zeitdruck für bestehende IT-Großsysteme zu entschärfen. Dieses Verfahren sieht einen Aufschub von 12 Monaten für die Konformitätsanforderungen von Hochrisiko-Systemen vor, die bereits vor Inkrafttreten des Gesetzes in Betrieb waren. Damit erhalten Unternehmen und Behörden den nötigen Spielraum, um komplexe Bestandssysteme rechtssicher an die neuen EU-Standards anzupassen. Weiter hat die EU Kommission jedoch klar gemacht, dass es beim AI Act nur eine Aufschub gibt, nicht aber mit einer Entschärfung in der Zukunft zu rechnen ist, wie es z.B. bei der CSDDD der Fall sein wird.

Aus Unternehmensperspektive formuliert:

Besonders der Einsatz von KI im eigenen Haus – um interne Prozesse und Themen zu lösen – macht die Regulierung jetzt unmittelbar relevant. Hier gilt es, die Umsetzung aktiv anzugehen.

Was ist jetzt konkret zu tun?

An erster Stelle steht der Aufbau einer lückenlosen Dokumentation. Es muss absolut transparent sein, wo und wie im Unternehmen eigentlich KI-Systeme verwendet werden. Dies ist die notwendige Absicherung, um sicherzustellen, dass keine Individualrechte verletzt werden, die der EU AI Act schützt. Ein weiterer wesentlicher Punkt ist das Aufsetzen von Schulungsmaßnahmen. Nur so ist gewährleistet, dass die Mitarbeitenden sauber verstehen, worum es beim Thema KI und dem EU-Regelwerk überhaupt geht und wie eine rechtssichere Nutzung in der Praxis aussieht.

Die EU-Kommission hat klargestellt, dass die Einhaltung keine Option, sondern eine zwingende Voraussetzung für den Marktzugang ist.

Der regulatorische Zeitstrahl (2024–2026)

| Datum | Meilenstein | Fokus für Compliance Manager |

| Juli 2024 | Verabschiedung | Finale Prüfung der Rechtskraft. |

| August 2024 | Inkrafttreten | Startschuss für die 6-monatige Frist für Verbote. |

| Februar 2025 | Verbotene Praktiken | Systeme, die ein inakzeptables Risiko darstellen, müssen abgeschaltet sein. |

| August 2025 | GPAI-Regeln | Pflichten für KI-Modelle mit allgemeinem Verwendungszweck greifen. |

| August 2026 | Volle Anwendung | Strenge Auflagen für Anwendungen mit hohem Risiko werden wirksam. |

Für deutsche Unternehmen bedeutet dies, dass die Umsetzung des AI-Gesetzes bis August 2026 abgeschlossen sein muss. Insbesondere die Sicherstellung der KI-Kompetenz (Art. 4) ist bereits seit 2025 eine laufende Verpflichtung, die eine kontinuierliche Schulung der Mitarbeitenden im Umgang mit KI-Systemen erfordert.

Definition eines KI-Systems: Was genau ein KI-System ist und was nicht ist in der Praxis noch nicht eindeutig bestimmbar

Die Definition, wann eine technische Lösung in der Praxis als KI-System definiert werden sollte, ist nicht 100% klar definiert. Der Art. 3 KI-VO definiert ein KI-System vereinfacht als ein maschinengestütztes System, dass in gewisser Weise autonom agiert und sich im Betrieb über die Zeit anpasst („lernt“), um die impliziten Ziele möglichst gut zu erreichen. Es generiert Ausgaben in nicht genau vorab spezifizierter Form, die physische oder virtuelle Umgebungen beeinflussen können.

Aus praktischer Sicht sei festzuhalten, dass KI-Systeme sich nicht nur auf die in der öffentlichen Wahrnehmung präsenten Large Language Models (LLMs) bezieht. Es gibt viele andere Modell-Typen die jeweils verschiedene Arten von Problemstellungen besonders gut lösen können. In Abgrenzung zu klassischen Software-Tools, bei denen die Eingaben und Ausgaben klar definiert waren und meist der Lösungsweg deterministisch vorgegeben wurde, sind bei KI-Systemen meist die Eingaben und Ausgaben undefiniert (bzw. so komplex dass sie menschlich schwer greifbar sind), oder der Lösungsweg von A nach B nicht menschlich nachvollziehbar.

KI-Systeme haben so ein großes Potential, das sie uns als Werkzeuge ermöglichen komplexe Probleme deutlich besser zu lösen als bisherige Technologien.

Risikobasierter Ansatz: Definition von KI und Anwendung in der Praxis

Der AI Act folgt einem risikobasierten Ansatz. Die rechtliche Definition von KI ist dabei bewusst weit gefasst, um verschiedene technologische Anwendungsfälle abzudecken. Im Kern geht es um die Unterscheidung, welches Gefährdungspotenzial von einer spezifischen KI ausgeht.

Die vier Risikostufen der KI-Verordnung

- Inakzeptables Risiko: Anwendungen, die gegen die Grundrechte von Menschen verstoßen, sind verboten. Hierzu zählt das Social Scoring, die biometrische Echtzeit-Identifizierung in öffentlichen Räumen oder manipulative Systeme, die das Verhalten von Nutzerinnen und Nutzern unbewusst steuern.

- Hohes Risiko: Diese Kategorie umfasst KI-Systeme in sensiblen Bereichen wie kritische Infrastruktur, Bildung, Personalwesen (Recruiting-Software) oder Strafverfolgung. Hier ist eine umfassende Konformitätsbewertung zwingend.

- Begrenztes Risiko: Hierzu zählen einfache Chatbots oder Systeme, die Deepfakes erzeugen. Die Hauptpflicht liegt in der Transparenz – Nutzer müssen wissen, dass sie mit einer KI interagieren.

- Minimales Risiko: Die Mehrheit der KI-Anwendungen, wie Spam-Filter oder KI in Videospielen, bleibt weitgehend unreguliert, wobei freiwillige Verhaltenskodizes empfohlen werden.

Einhaltung der Vorschriften: Die Rolle der Bundesnetzagentur und des AI Office

In Deutschland liegt die Aufsicht über das EU-Gesetz zur Künstlichen Intelligenz primär bei der Bundesnetzagentur (BNetzA). Diese fungiert als Bindeglied zum europäischen AI Office (Amt für Künstliche Intelligenz) der Europäischen Kommission.

Aufgaben der nationalen Behörden

Die BNetzA hat im Rahmen des KI-Gesetzes die Aufgabe, die Überwachung der Einhaltung sicherzustellen. Dies umfasst:

- Die Einrichtung eines AI Act Service Desk, um Fragen von KMU (kleine und mittlere Unternehmen) und Start-ups zu beantworten.

- Die Bereitstellung eines AI Act Explorer-Tools, das als praktisches Tool bei der Einstufung von Systemen helfen soll.

- Die Koordination eines Gremiums unabhängiger Experten, die bei der Bewertung komplexer technischer Fragen unterstützen.

Deutsche Unternehmen müssen sich darauf einstellen, dass die Durchsetzung der KI-Verordnung streng erfolgt. Bußgelder bei Nichteinhaltung können existenzbedrohend sein und orientieren sich am globalen Jahresumsatz.

KI-Modelle für allgemeine Zwecke: Fokus auf GPAI und LLMs

Einer der intensivsten Teile der aktuellen Debatte betrifft KI-Modelle für allgemeine Zwecke (GPAI). Diese KI-Modelle (wie GPT-4 oder vergleichbare LLMs) dienen als Basis für unzählige spezifische KI-Anwendungen.

Anforderungen an KI-Modelle mit allgemeinem Verwendungszweck

Anbieter von KI-Modellen müssen seit August 2025 detaillierte Dokumentationen vorlegen:

- Transparenz beim Training: Es muss offengelegt werden, welche Daten für das Training von KI verwendet wurden, insbesondere im Hinblick auf das Urheberrecht.

- Systemische Risiken: Modelle mit besonders hoher Rechenleistung müssen zusätzliche Tests durchlaufen, um Gefahren für die Cybersicherheit oder gesellschaftliche Stabilität zu minimieren.

- Leitlinie der EU-Kommission: Die EU-Kommission veröffentlicht regelmäßig neue Standards, um die Einhaltung der Vorschriften für diese hochkomplexen Modelle zu präzisieren.

Hands-on: So bereiten Compliance-Manager die Umsetzung vor

Die Umsetzung des AI-Gesetzes erfordert einen strukturierten Prozess. Als Compliance-Verantwortlicher sollten Sie die folgenden Schritte in Ihren Leitlinie-Katalog aufnehmen:

- Inventur und Risikobewertung: Erfassen Sie alle im Unternehmen eingesetzten KI-Systeme. Nehmen sie eine Risikoeinstufung vor (hierbei können der AI Act Explorer oder darüber hinaus Softwarelösungen von eagle Softwarepartner hilfreich sein). Prüfen Sie insbesondere Anwendungen im Bereich HR oder Finanzen, da diese oft als Anwendungen mit hohem Risiko gelten.

- Sicherstellung der KI-Kompetenz: Die Nutzung von KI setzt voraus, dass die Anwender die Funktionsweise und Risiken verstehen. Führen Sie verpflichtende Schulungs-Maßnahmen durch, die Risiken und Chancen ausgeglichen erläutern. Dies ist jedoch keine konkrete gesetzliche Pflicht, aber einer der effektivsten Bausteine und schützt das Unternehmen.

- Anpassung der Verträge mit Drittanbietern: Wenn Sie externe KI-Modelle in ihre Anwendungsfälle integrieren, müssen Sie sicherstellen, dass die Trainingsdaten möglichst frei von Bias sind. Verlangen Sie technische Dokumentationen und Nachweise über die Einhaltung von Sicherheitsstandards. Eine vertragliche Abtretung des Haftungsrisikos an der Anbieter von KI-Systemen sehen wir als unrealistisch an. Der Betreiber ist für die Einhaltung der AI Act Anforderungen in dem einzelnen Anwendungsfall zuständig.

- Transparenz-Mechanismen implementieren: Stellen Sie sicher, dass jeder Chatbot im Unternehmen klar als solcher gekennzeichnet ist. Für die Erstellung von Inhalten durch KI müssen Wasserzeichen oder Metadaten-Tags verwendet werden, um die Herkunft transparent zu machen.

Förderung von Innovation: KMU und Start-ups im Blick

Trotz der strengen Regulierung bietet das KI-Gesetz Mechanismen zur Vereinfachung für kleinere Akteure. Die EU-Kommission fördert die Einrichtung von Reallaboren, in denen Start-ups ihre Innovationen unter behördlicher Aufsicht testen können, bevor die volle Last der Compliance greift.

Vorteile für kleine und mittlere Unternehmen:

- Reduzierte Gebühren für Konformitätsbewertungen.

- Priorisierter Zugang zum AI Act Service Desk.

- Spezielle Leitfäden zur Einhaltung, die auf geringere Ressourcen zugeschnitten sind.

Fazit: Vertrauenswürdige Künstliche Intelligenz als Wettbewerbsvorteil

Zusammenfassend lässt sich sagen, dass der EU AI Act die Basis für eine neue Ära der Artificial Intelligence in Europa legt. Der Umgang mit KI wird durch das Gesetz über Künstliche Intelligenz professionalisiert. Unternehmen, die den Einsatz der KI proaktiv gestalten und die Einhaltung der Vorschriften als Teil ihrer Unternehmensethik begreifen, werden langfristig das Vertrauen ihrer Kunden gewinnen.

Beginnen Sie heute damit, Ihre KI-Kompetenz zu stärken und die Weichen für ein vertrauenswürdiges Management Ihrer KI-Systeme zu stellen. Die aktuelle Debatte zeigt deutlich: Wer die Regulierung von KI ignoriert, riskiert nicht nur Strafen, sondern auch den Verlust der gesellschaftlichen Akzeptanz.